A aplicação da inteligência artificial na saúde avança do ganho de eficiência operacional para a personalização do cuidado, mas ainda enfrenta desafios estruturais ligados a dados, segurança e padronização. O tema foi debatido a conferência Saúde & Farma, por Daniele de Mari, fundadora da Neurogram, e pelo jornalista Luiz Pacete, durante uma discussão sobre os limites e as possibilidades da IA no setor.

A aproximação de Daniele de Mari com a saúde começou na infância. Aos 11 anos, sua avó recebeu o diagnóstico de câncer, após um processo de investigação iniciado quando Daniele tinha 9 anos. No ano seguinte, outro amigo da família morreu em decorrência da doença. A experiência despertou uma indignação com as limitações tecnológicas existentes para diagnóstico e acompanhamento clínico.

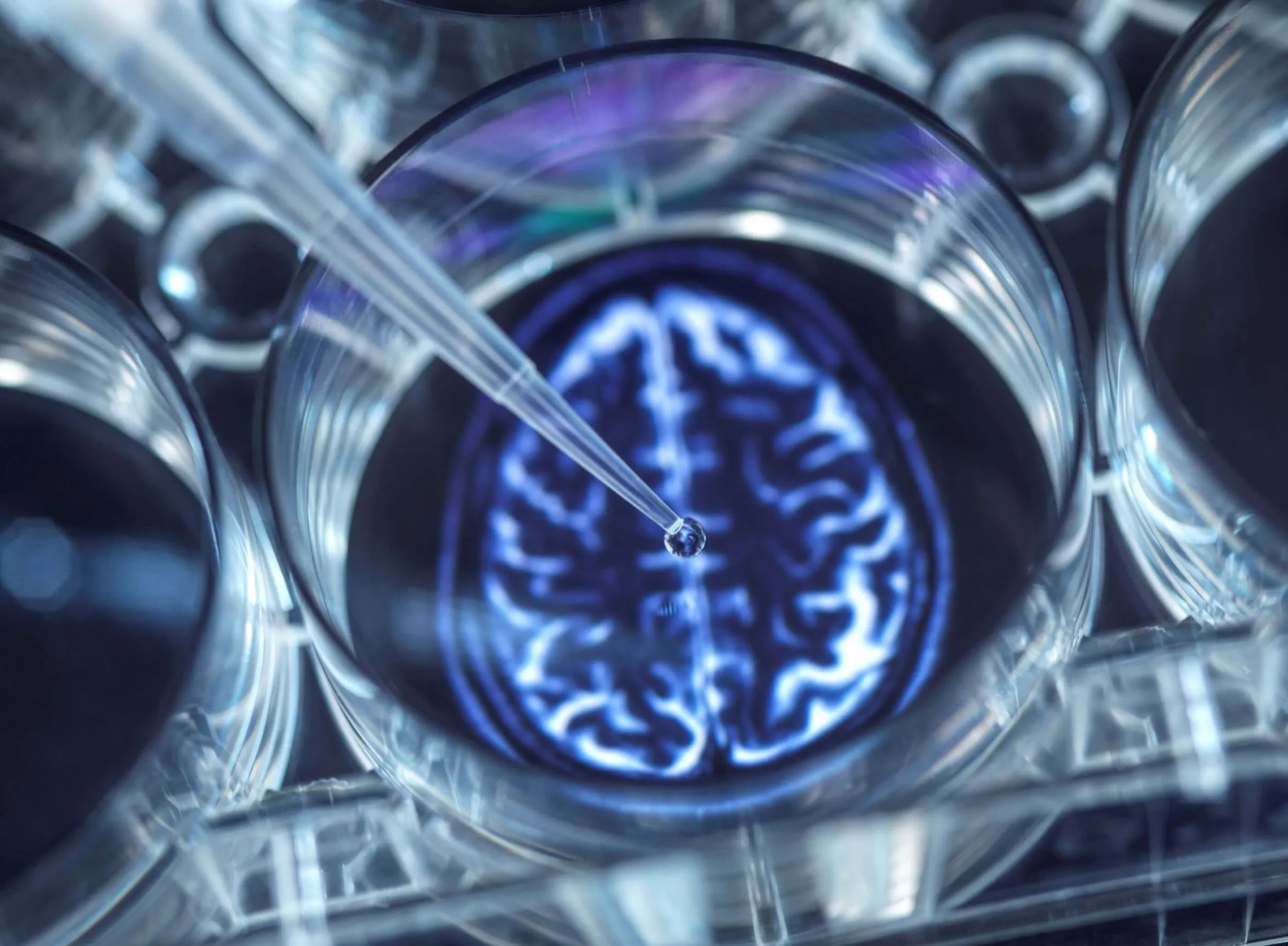

Formada em neurociência pelo Georgia Institute of Technology, Daniele relata que o interesse inicial era atuar em pesquisa acadêmica, especialmente na classificação de ondas cerebrais para análise da atividade elétrica do cérebro. Esse trabalho se intensificou durante a pandemia, quando passou a estruturar estudos voltados à leitura de sinais neurais em escala. A partir dessas pesquisas, desenvolveu uma inteligência artificial capaz de identificar padrões nos dados cerebrais. “O cérebro nos fala muita coisa e a gente não consegue ler, mas não por uma limitação tecnológica, mas sim porque não temos por onde ler esse dado, não tem um banco de dados”, afirma.

A pergunta “e se a gente tivesse como medir?” marcou o ponto de partida do projeto. Segundo a executiva, quantificar transtornos neurológicos ou doenças esbarra em um problema central: os sistemas não se comunicam entre si. Para criar índices de normalidade ou anormalidade, é necessário construir bases de dados amplas e padronizadas. “Se a gente quiser entender o que é um Alzheimer, por exemplo, esbarramos nesse problema”, diz.

Além da ausência de interoperabilidade, a segurança da informação surge como um dos principais entraves. Segundo Daniele, dados de saúde não podem ser armazenados em soluções genéricas como Dropbox ou Google Docs. O primeiro desafio é garantir a proteção dessas informações; o segundo é a padronização. “Todos precisam falar a mesma língua”, afirma. Ela cita ainda o desalinhamento regulatório no Brasil, onde a LGPD exige rigor na proteção de dados, enquanto a ausência de um prontuário eletrônico nacional dificulta a fiscalização por parte da Anvisa, embora as operações precisem estar em conformidade com a legislação de dados.

Entre as informações coletadas estão registros de ondas cerebrais captadas por eletrodos com 19 canais, além do histórico clínico do paciente e do desfecho do laudo médico. A combinação desses dados permite treinar modelos de IA mais precisos, capazes de apoiar decisões clínicas e reduzir subjetividades na interpretação dos exames.

Apesar do potencial, Daniele alerta para riscos associados ao uso indevido dessas informações. Um dos perigos, segundo ela, está na leitura da atividade cerebral por dispositivos utilizados no dia a dia, especialmente com fins comerciais. “Muito cuidado com o que esse dado está sendo usado”, afirma. O alerta é direcionado ao uso desses dados por grandes empresas de tecnologia, que podem monitorar atividades cerebrais para direcionar publicidade, recomendar produtos e intensificar estímulos ao consumo.

Para a executiva, o avanço da IA na saúde precisa caminhar junto com debates éticos, governança de dados e limites claros sobre como informações sensíveis podem ser utilizadas, sob risco de comprometer a confiança e a própria finalidade do cuidado personalizado.